[To drugi wpis z serii czterech tekstów o dezinformacji, których autorami są przedstawiciele organizacji Drog zajmującej się analizą zjawiska dezinformacji i napisali je dla holenderskiej platformy Frankwatching.]

W poprzednim artykule odpowiedzieliśmy na pytanie, czym jest dezinformacja. Tym razem omówimy działania podejmowane, aby ją zwalczać.

Rodzaje działań

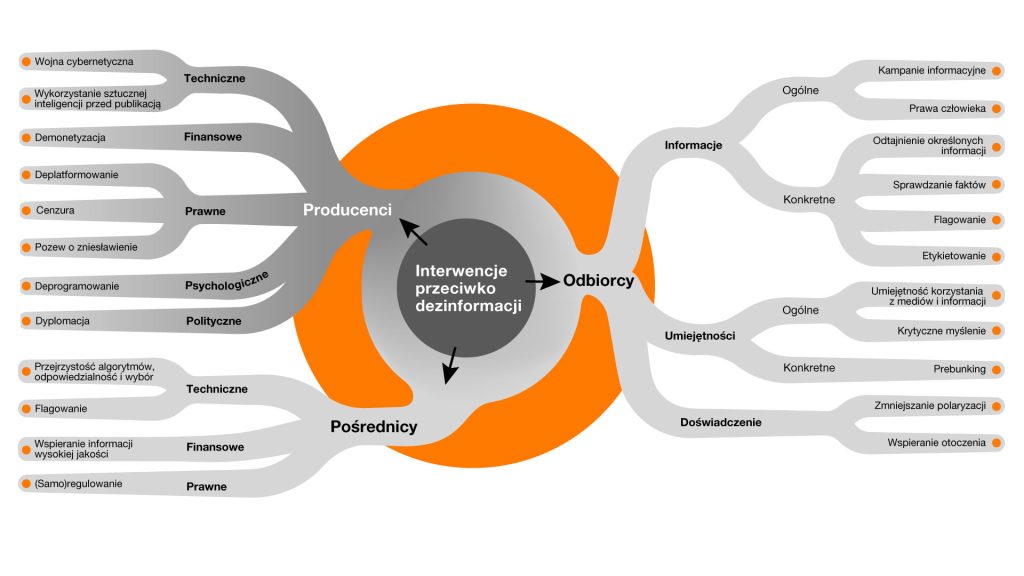

Walka z dezinformacją przybiera wiele form: od wojny w cyberprzestrzeni po umiejętność korzystania z mediów i od cenzury po weryfikację faktów. Rodzaje interwencji obejmują np. debunkowanie (demaskowanie), oflagowywanie i epistomologię uliczną (ang. street epistemology). „Trudno jest dostrzec drewno w drzewach”, dlatego aby ujrzeć istotę problemu, konieczne jest uporządkowanie mnogości opcji.

Docelowi odbiorcy

Jednym ze sposobów uporządkowania działań przeciwko dezinformacji jest przyjrzenie się grupom docelowym, do których są one kierowane. W zasadzie, zgodnie z definicją Unii Europejskiej, istnieją tylko dwie takie grupy: ci, którzy oszukują oraz ci, którzy mogą zostać oszukani. Do pierwszej z nich zalicza się wszystkich, którzy tworzą, przedstawiają i rozpowszechniają dezinformację.

Trudność kategoryzacji

Trudną do sklasyfikowania grupą są „zwykli” ludzie, którzy rozpowszechniają dezinformację tylko z przyzwyczajenia[1]. Z jednej strony grupa ta może podlegać pod kategorię oszustów, ponieważ szerzy dezinformację, ale z drugiej może być postrzegana jako oszukana, ponieważ dała się nabrać. Należy jednak zauważyć, że oszukani, którzy rozpowszechniają dezinformację bez złych intencji, mogą nieświadomie wyrządzić znaczne szkody[2].

Podobny problem istnieje w odniesieniu do mediów tradycyjnych i społecznościowych. Kierując się zasadą, że wszystkie strony muszą być wysłuchane w równym stopniu, media udostępniają czas antenowy nawet przedstawicielom grup skrajnych o wątpliwych źródłach finansowania i stanowią w ten sposób platformę dla osób rozpowszechniających dezinformację. Lee McIntyre (Post Truth, 2018) przekonuje, że dyskusja, w której uczestniczą osoby szerzące dezinformacje, znacząco odbiega od powszechnie przyjętych zasad. Nie ma w niej równorzędnych stron próbujących przekonać dyskutantów do swoich racji. Zamiast tego mamy stronę prowadzącą normalną dyskusję oraz stronę próbującą podporządkować sobie tę drugą. Zdaniem McIntyre'a, media są chętnie wykorzystywane przez osoby rozpowszechniające dezinformacje. Częściowo dlatego, że media same czerpią z tego korzyści – brutalne konfrontacje ze skrajnymi opiniami generują wyższą oglądalność i wymagają mniejszego przygotowania niż merytoryczne potraktowanie tematu. Czy oznacza to, że media oszukują czy są oszukiwane?

A co z mediami społecznościowymi? Ich model biznesowy doskonale wpisuje się w metody stosowane przez oszustów. Dostarczają one ludziom informacji, przy jednoczesnym zapewnianiu reklamodawców, że mogą wpływać na decyzje użytkowników. Nie jest istotne, czy dotyczy to zachowań zakupowych czy związanych z głosowaniem. Czy oznacza to, że media społecznościowe oszukują?

Korekty

Sensowne wydaje się stworzenie trzeciej grupy docelowej dla mediów tradycyjnych i społecznościowych – grupy pośredników, które działają jak chętni dystrybutorzy. Należy wymagać od nich przejrzystości i odpowiedzialności, aby nie mogli się „schować” za argumentem, że też zostali oszukani.

W przeciwieństwie do pośredników, zwykli obywatele rozpowszechniający dezinformację nie są profesjonalistami. Definicja Unii Europejskiej nie dostarcza jednak żadnych wskazówek, które pozwoliłyby zdecydować, czy należą oni do oszukujących czy oszukanych. Do określenia ich przynależności potrzebne jest nowe kryterium. Dobrym byłaby odpowiedź na pytanie: czy rozpowszechnianie przez nich dezinformacji jest skoordynowane? Jeżeli obywatele są kierowani przez osoby odpowiedzialne za dezinformację, wówczas należą do grupy oszustów. Jeśli nie, należy ich uznać za oszukanych.

Klasyfikacja grupy docelowej

Podział na grupy docelowe ułatwia decydentom i osobom zwalczającym dezinformację wybór konkretnej formy interwencji. Dla każdej grupy docelowej istnieją specyficzne interwencje, które można zastosować. Na przykład, w odniesieniu do odbiorców dezinformacji, działania mogą skupiać się na lepszym informowaniu tej grupy (od kampanii informacyjnych po fact-checking), na poprawie umiejętności korzystania z mediów (np. poprzez prebunking) lub na społecznych konsekwencjach dezinformacji (np. poprzez zapewnienie wsparcia dla otoczenia zradykalizowanych przyjaciół lub członków rodziny). W odniesieniu do pośredników można stosować interwencje techniczne (np. poprawić przejrzystość algorytmów lub wymóc wolność wyboru algorytmów), interwencje finansowe (np. wspieranie mediów wysokiej jakości) lub interwencje prawne (np. nowe przepisy). Jeżeli chodzi o twórców, do wyboru są interwencje techniczne (np. wojna cybernetyczna lub wykorzystanie sztucznej inteligencji), interwencje finansowe (podważenie modelu przychodów), interwencje prawne (cenzura, pozwy o zniesławienie) lub interwencje polityczne (dyplomacja).

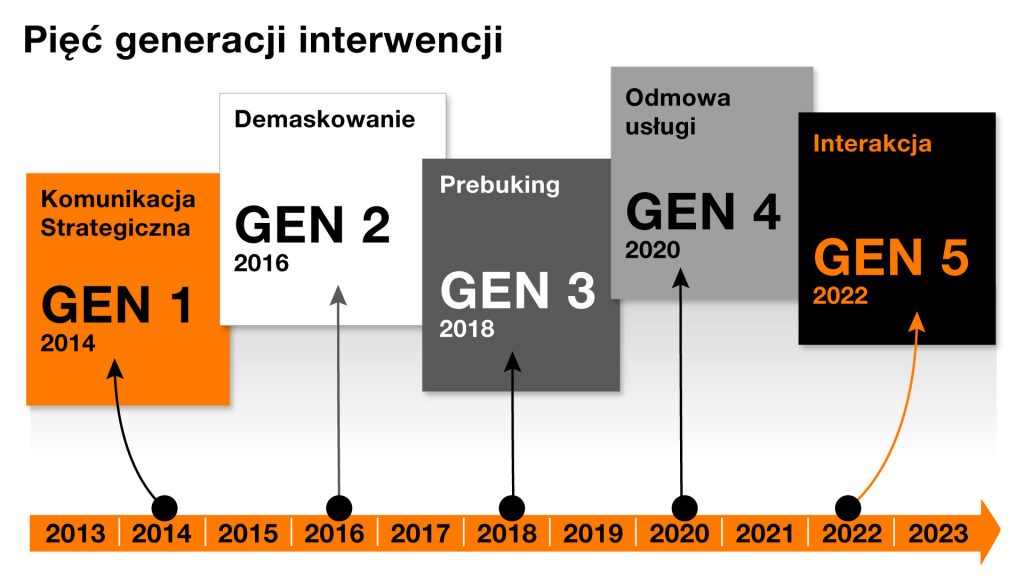

Porządek historyczny – model interwencji Drog (Drog Intervention Model DIM)

Dezinformacja ulega ciągłym zmianom, ewoluuje i dostosowuje się do nowych warunków. Osoby zwalczające dezinformację reagują na zmieniające się okoliczności. W rezultacie ich działań pojawiło się pięć generacji interwencji. W każdej z nich zwrócono uwagę na inny problem. Reprezentują one także podejście rządów do pojawiających się w danym czasie problemów. Kolejne generacje mogą być wykorzystane przez zwalczających dezinformacje jako swoiste „menu” działań do wyboru – na początek należy zadać sobie pytanie: która generacja najlepiej pasuje do mojego problemu i możliwości mojej organizacji?

Gen 1: Komunikacja strategiczna

Pierwsza generacja interwencji pochodzi z 2012 roku. Bezpośrednim powodem jej powstania była rekrutacja sympatyków przez tzw. Państwo Islamskie ISIS. Zidentyfikowanym problemem była obca ingerencja w sprawy wewnętrzne. Analiza problemu wskazała, że obywatele mieli niedobór prawdziwych informacji i dlatego byli podatni na zewnętrzną propagandę. Według tej generacji rozwiązaniem problemu jest lepsze informowanie obywateli o faktach za pomocą dużych, strategicznych kampanii komunikacyjnych. Za dostarczanie prawdziwych informacji odpowiedzialne są służby wywiadowcze (wojskowe)[3] oraz organizacje pozarządowe, a celem tych działań jest stworzenie bardziej odpornego społeczeństwa obywatelskiego. Przykładem interwencji pierwszej generacji „Gen 1” było szybkie opublikowanie informacji wojskowych o ruchach jednostek armii rosyjskiej tuż przed inwazją na Ukrainę w 2022 roku. Pozwoliło to podważyć rosyjskie działania dezinformacyjne, w ramach których Kreml twierdziłyby, jakoby odpowiedzialność za inwazję leżała po stronie Ukrainy[4].

Gen 2: Demaskowanie (Debunking)

Począwszy od 2014 roku, pojawiła się odpowiedź na drugie zagrożenie dezinformacyjne – populistów wygrywających wybory. Często wykorzystywali oni „fakty alternatywne” i oskarżali przeciwników o rozpowszechnianie tzw. fake newsów. Według drugiej generacji interwencji konieczne jest oddzielenie ziarna od plew. Opinia publiczna powinna być informowana o tym, które twierdzenia są prawdziwe, a które sfabrykowane. Flagowym działaniem podejmowanym w ramach tej generacji jest weryfikacja faktów (fact-checking) przez naukowców i dziennikarzy, wykorzystujących swoją wiedzę do określenia poziomu wiarygodności danej informacji.

Gen 3: Prebunking

Od 2018 roku w centrum uwagi części osób zainteresowanych i analizujących zjawisko dezinformacji znalazły się nie tyle fake newsy, co kompleksowe teorie spiskowe. Składają się one z mieszaniny twierdzeń, które często są ze sobą sprzeczne. Trzecia generacja interwencji skupia się zatem na ujawnianiu niespójności dezinformacji. Według jej zasad, gdyby obywatele nauczyli się dostrzegać, jak nielogiczne i niepoprawne jest rozumowanie zwolenników teorii spiskowych, lepiej radziliby sobie z ich przeciwstawieniem. Trzecia generacja interwencji ma na celu niejako zaszczepienie obywateli przeciwko wirusowi dezinformacji. Można przeprowadzić to np. za pomocą gier, takich jak Bad News[5]. Ludzie powinni uzyskać wgląd w metody stosowane przez osoby rozpowszechniające dezinformację i poznać je poprzez samodzielną naukę ich stosowania. Dzięki zrozumieniu metod działania dezinformacji ludzie będą w stanie lepiej je rozpoznawać.

Gen 4: Odmowa usługi

Wybuch pandemii COVID-19 w 2020 r. przyniósł tzw. infodemię[6]. Doprowadziło to do powstania czwartej generacji interwencji – twardych metod przeciwdziałania dezinformacji. Zamiast uodparniać obywateli na jej działanie, nacisk przesunął się na maksymalne utrudnianie rozpowszechniania fałszywych informacji, aby zatrzymać rozwój dezinformacji lub przynajmniej uczynić go możliwym do opanowania. Rosyjskie media państwowe zostały zabronione w wielu państwach Zachodu, a osoby szerzące teorie spiskowe wyrzucone z mediów społecznościowych lub przynajmniej zablokowano im możliwość czerpania dochodów z publikowanych tam treści. Wszczęto i wygrano także procesy sądowe przeciwko osobom szerzącym dezinformacje, takim jak popularyzator teorii spiskowych Alex Jones. W UE także szybko przyjęto liczne nowe przepisy, aby prawnie wspierać tego typu działania.

Gen 5: Interakcja

Po 2020 roku ton debaty publicznej stał się ostrzejszy. Małe grupy o skrajnych poglądach zaczęły dominować w dyskusjach, irytując większość obywateli[7]. Podczas gdy większość społeczeństwa stosuje się do naukowo uzasadnionych rad, poważnie traktuje informacje pochodzące z mediów i od polityków, mniejsze grupy zaczęły ogłaszać, że nie będą już postępować zgodnie z tym, co zostało przekazane z góry[8]. Grupy te czuły się niewidziane i niesłyszane. Uważały, że są pokrzywdzone, a nawet zagrożone. Większość społeczeństwa patrzy jednak na ich członków, jak na zagorzałych zwolenników fikcji pozbawionej faktów. Natomiast członkowie tych grup gardzą większością, określając ją jako bezkrytyczne i „potulne owieczki”. Ponieważ do tych mniejszościowych grup nie mogą już dotrzeć naukowcy, decydenci czy politycy, piąta generacja interwencji stawia sobie za cel zbliżenie do siebie obywateli z obu obozów i rozpoczęcie pomiędzy nimi dialogu. Chodzi o to, że musimy zacząć słuchać siebie nawzajem oraz dyskutować otwarcie i z szacunkiem, aby zrozumieć, jak powstały różnice w naszych poglądach. Pierwszym krokiem jest przełamanie naszego „naiwnego realizmu” – przekonania, że patrzymy na rzeczywistość obiektywnie, podczas gdy wszyscy inni są targani uprzedzeniami.

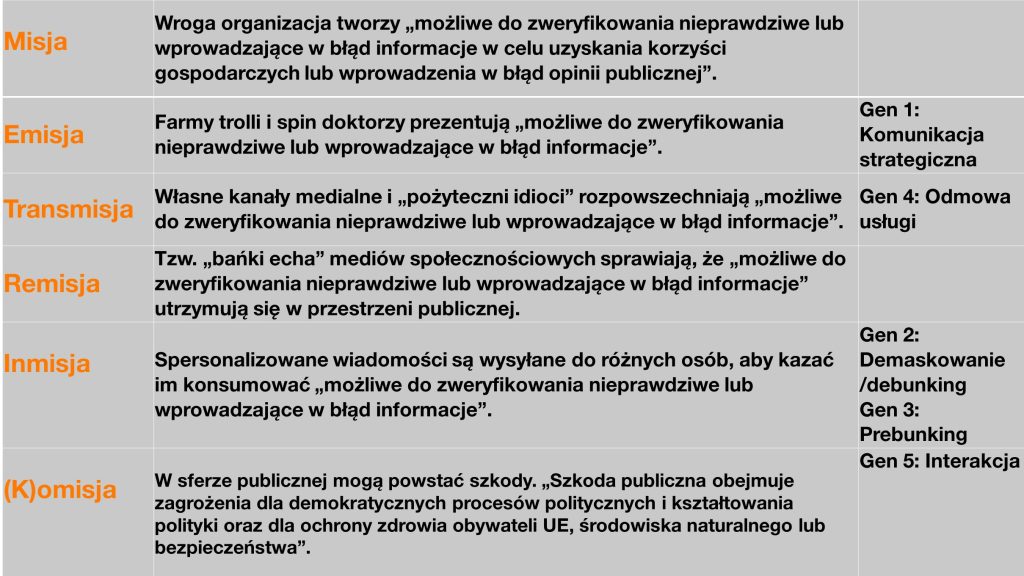

Drog Intervention Model (DIM) i model standardowy

Możliwe jest dostosowanie składającego się z pięciu generacji modelu ingerencji do standardowego modelu dezinformacji. W tabeli zaznaczono ogniwa łańcucha dezinformacji, które można przerwać poprzez dokonanie interwencji w ramach konkretnej generacji.

W trzecim z serii czterech tekstów przedstawimy naszą ocenę standardowego modelu dezinformacji. Model ten ma bowiem pewne wady. Te niedociągnięcia nie są jednak „błędem”, a „cechą” modelu standardowego.

AUTORZY

- Onno Hansen-Staszyński - specjalista ds. edukacji, rozwoju kompetencji cyfrowych, przeciwdziałania dezinformacji i kwestii tożsamości cyfrowej. Zainicjował wdrażanie praw dziecka w Unii Europejskiej i był członkiem grupy ekspertów Komisji ds. Cyfryzacji i Zwalczania dezinformacji w szkołach. Obecnie jest m.in. doradcą Drog i wraz z żoną Beatą Staszyńską-Hansen trenerem nauczycieli w Akademii Dynamicznej Tożsamość oraz nauczycielem w LO 4 w Gdańsku.

- Bram Alkema - przedsiębiorca społeczny i specjalista w zakresie publicznych strategii komunikacji cyfrowej. Studiował ekonomię na Uniwersytecie w Groningen.

- Ruurd Oosterwoud - założyciel i dyrektor DROG, firmy społecznej zajmującej się interwencjami przeciwko dezinformacji. Jest magistrem rusycystyki na Uniwersytecie w Leiden, podczas jego studiów na uniwersytecie zaczynała się jego obsesja na punkcie propagandy.